VtubeKit, 开发包含三部分:一. lab/Face Extractor( 素材采集和处理部分 ) 二 .Trainer(模型训练) 三.Live(Deepfacelive的功能及附加功能) 四。对XSeg编辑器做了功能拓展

第一部分:素材准备工具集 Face lab/Face Extractor

(-)人脸采集/切脸

1.采集源额外增加了桌面和窗口截屏,这样可以直接在视频播放器或者桌面中直接采集人脸了。

2.人脸检测引擎默认使用YoLoV5的Onnx模型.

3. 增加了人脸身份筛选功能可以过滤掉非目标人脸,减少人脸筛选工作量

4.设置了人脸尺寸过滤,在提取阶段就去掉过小的人脸避免素材模糊

5.人脸提取阶段就计算了特征点和遮罩并保存到图片信息中,后续不再需要再次计算人脸遮罩

6.可以单帧采集(适合网页中人工采集),也可以自动连续采集(适合视频或者直播画面采集),可以设置自动采集间隔时间

7.提取和保存有快捷键功能,可以实现快速的人工采集,避免重复鼠标点击

(二)人脸批量编辑

1. 对其他软件已切脸素材处理:非目标对象挑选,写入遮罩,文件批量重命名

2. 用GPEN超分辨(内置包中没有包含pytorch,需要自己在python的site-packages中装pytorch)

3.保留遮罩和特征点的缩放

4.素材增强:面部随机遮挡物体的添加(以及遮挡物轮廓绘制)

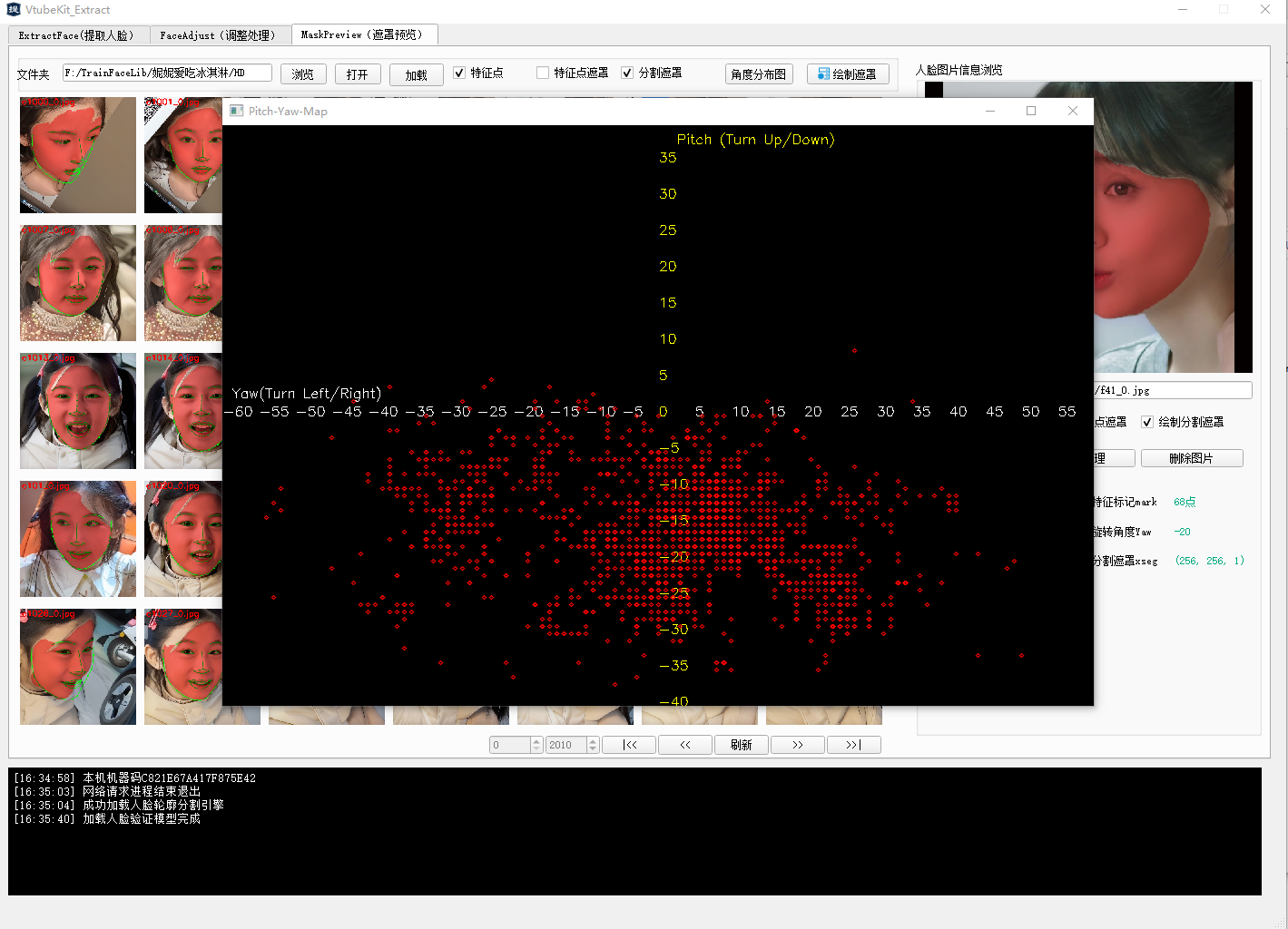

(三)遮罩预览

1.批量显示遮罩预览,特征点预览,角度信息

2.可生成素材的角度分布图谱

3.手工绘制修改错误遮罩

人脸角度图生成

第二部分: 模型训练器(Trainer)

(一)模型训练:

1. 图形化的训练界面,创建新模型或者加载已有模型训练,直接选路径就可以了

2.读取模型参数并显示

3. 开始训练模型前不用再一遍又一遍的输入参数了,点选参数后直接运行训练就可以了

4. 增加了学习率、损失函数中结构相似性、像素值差异,以及嘴眼优先等超参数的调节

5.素材加载增加了是否加载子目录的选择

6. 训练画面预览(全部采用5列预览图的布局,包括256以上的模型,训练大模型的时候也可以预览多列了)

7。新增了效果测试。以往训练的时候只能看到训练集图片的预测结果。trainer 可以在训练的过程中直接测试真实环境中的图片换脸效果。

素材可以是图片,也可以实时截屏。而且效果是merge之后的效果,分3列显示

8.定期对loss比较高的素材多增加次数

9. 训练单次迭代时间有所减短

(二)模型保护:

(1)dfm直播模型可以转换为vtfm模型,可以采用密码保护,或者采用单机密码 机器码的形式保护,保护你辛苦的炼丹成果不被人转卖。

第三部分: 实时换脸(Live)

(一):Live直播

1.增加了屏幕捕获的视频源输入,可以一边看视频,一边看换脸之后的结果了

2. 增加了人脸筛选功能(不过准确度不是特别高)

3.增加了瘦脸和瘦下巴功能,目前是常规的瘦脸算法(远期准备增加脸型自动匹配)

4.可选实时分割遮罩功能(应用xseg遮罩从输入align 人脸计算遮罩),比从模型得到这招相对来说可以更准确,自由度更大

5.增加了一键保存输出图功能。还有一键录制视频 声音。 而不用像原版一样必须保存长序列图片。